林俊旸夜深发文“告别”千问,在AI圈中引起山地风云,也让“周浩”这个名字过问公众视线。

2026年1月,周浩低调加入阿里,第一站不是通义实验室,而是先挂靠在夸克。

在夸克片霎过渡之后,周浩就地转入通义实验室,接替同日下野的后检修认真东谈主郁博文,讨教线奏凯拉到阿里云 CTO、通义实验室认真东谈主周靖东谈主。

周浩本科毕业于中国科学技能大学,2019年在威斯康星大学麦迪逊分校获得机器学习与盘算机视觉主见的博士学位,随后在Meta作念了一段AI基础野心,积存了大畛域模子检修的工程劝诫。

委果让他成名的地点是DeepMind。

自从加入DeepMind以后,周浩在哪里一齐升至高档主任野心科学家(Senior Staff Research Scientist),这是谷歌野心体系中少量数东谈主能涉及的级别。

同期周浩也成为了Gemini强化学习与自我调动(RL & Self-Improvement)团队的认真东谈主。

从Gemini 1.5到现如今的Gemini 3 Pro,周浩参与了谷歌旗舰大模子中枢功能的研发使命。

那么周浩能为千问带来什么?

谜底藏在他当年几年在DeepMind里作念的事情里。

01

周浩有什么才略?

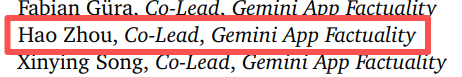

2023年,在Gemini 1.0的技能讲述中,周浩担任“Gemini App Factuality Co-Lead”(Gemini APP事实性聚积认真东谈主)这一职位,他的中枢职责是保险Gemini面向C端用户的输出事实准确性,输出的信息准确、可靠,不会“一册稳妥地瞎掰八谈”。

说白了即是让模子从后检修到落地,整个经由里减少幻觉。

一个模子不错在学术benchmark上跑出漂亮的分数,但如若它在申诉“今天天气若何样”时虚构数据,在法律问答时援用不存在的法条,那这个模子即是祸害。

传统的作念法是过后检测。也即是让模子先生成谜底,然后用另一个系统去给如故生成好的谜底进行考据。

但这种顺序资本高、蔓延大,况兼很难隐秘所有场景。

周浩和团队在Gemini上作念的事实性使命,是从模子检修和强化学习的起源脱手。

通过假想特地的奖励函数和检修策略,让模子在生成每一个token的时候,就内化了“事实准确性”这个禁止。

这不是简短地让模子记着更多学问,而是让模子学会分歧“我知谈的事实”和“我省略情的臆想”,在省略情的时候主动镌汰置信度,致使终止申诉,而不是硬着头皮瞎编。

这套事实性保险体系的效果,体当今了Gemini的试验发达上。

技能讲述中指出,Gemini Ultra在MMLU(大畛域多任务话语意会)基准测试中获得了90.04%的准确率,成为首个卓越东谈主类人人水平(89.8%)的AI模子。

MMLU涵盖数学、物理、历史、法律、医学、伦理等 57 个学科畛域,是估量模子学问广度和准确性的巨擘基准。

更重要的是,技能讲述相等强调Gemini模子在事实性关系任务上展现出“exceptionally strong performance on factuality”(在事实性方面发达异常强盛),这奏凯考据了周浩团队在欺诈层面事实性保险使命的见效。

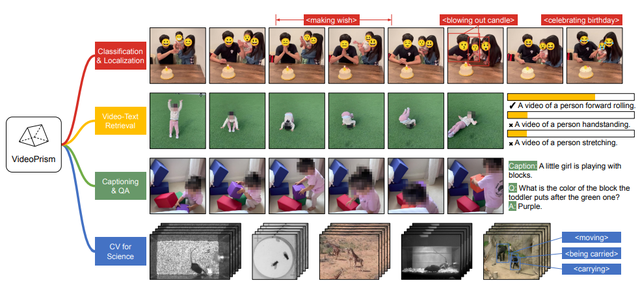

如若说在Gemini 1.0时期,周浩措置的是“若何让AI雄厚到极端”,那么到了2024年,周浩动作中枢孝敬者参与的VideoPrism,它措置的即是“若何让AI看懂视频”。

这篇论文本色上是构建了一个视频基础编码器,简略处理从科学视频到监控摄像等各类视频内容。

以前的AI“看视频”,其实是把视频拆成一帧一帧的图片分别看,就像把一部电影剪成几千张截图然后逐张分析。它能认出画面里有什么,但压根不懂“前后发生了什么”。

VideoPrism则是让AI意会视频里的时刻流动。比如看一段作念菜视频,它不仅知谈“这是一个厨房、有一个东谈主、有一口锅”,还能意会“这个东谈主先切菜、然后热油、然后下锅炒”这个动作序列。

VideoPrism的中枢想路是将大畛域视频-文本对数据与纯视频数据团结,通过两阶段检修,让模子同期学会语义意会和视觉细节。

第一阶段用对比学习让模子学会匹配视频和文本姿色,第二阶段用掩码自编码让模子学会预测视频中被遮拦的部分。

这个假想让VideoPrism简略从两种互补的信号中学习。文本姿色提供语义信息,视频内容提供视觉动态信息。

在33个视频意会基准测试中,VideoPrism在31个上达到了最优性能,况兼用的是归拢个冻结模子,险些不需要针对不同任务作念适配。

这个使命被奏凯产物化过问谷歌的多模态体系,是Gemini视频意会才智的技能基石之一。

周浩一样亦然Gemini 3.0的要害孝敬者(Key Contributor)。在这个模子上,他具体认确切是多样貌强化学习(Multi-step RL),翻译成东谈主话,开云体育中国官方网站即是让模子在措置复杂问题时,简略进行多轮想考、规画、推论、反想的链式推理才智。

Gemini DeepThink(深度想考模式)和DeepResearch(深度野心)等功能即是因此而来的。

等闲的AI申诉问题,是“想一步、说一步”。你问它一个复杂问题,它重新到尾生成一遍谜底就结束,半途不会停驻来质疑我方。

周浩作念的事,是让AI学会“连气儿想好几步”。

AI会先拆解问题、制定规画,然后一步步推论,每走一步皆回头查验“这步走对了吗?下一步该若何走?”。

这么一来,Gemini的DeepResearch功能就不错帮你自动搜索几十个网页,再轮廓搜索戒指,给你写出一份有逻辑的野心讲述。而不是像其他大模子一样,把搜索戒指连气儿“喷”出来,因为它确切是在一步阵势想考和规画。

周浩的野心道路启示有一条认识的干线。

从最一运转让AI我方明白什么是错的,再让AI雄厚到时刻序列这个抽象主张,临了通过多样貌强化学习让AI学会规画和反想。

跟着时刻的推移,AI能意会的事物越来越复杂,也越来越能措置委果的用户需求。

有风趣的是,这个发展轨迹,恰巧即是千问接下来要走的路。

02

千问刚刚完成一次技能跃迁

在我看来,周浩的野心主见,与Qwen 3.5 如故走到的技能节点,造成了高度精确的“卡槽对接”。

Qwen 3.5在2026年2月发布,这是千问系列的最新旗舰版块。它遴选了搀和架构,团结了Gated DeltaNet和寥落搀和人人(MoE)两种技能。

旗舰模子Qwen3.5-397B-A17B总参数目为3970亿,但每次推理只激活170亿参数,这么的假想简略让它在保抓高性能的同期,资本镌汰了60%,朦拢量普及了8倍。

虽说Qwen 3.5在架构和预检修上如故作念到了天下级水准,开云体育下载但它的后检修阶段却不够出色。尤其是若何让模子委果学会推理、反想、自我纠错,这恰是千问的短板。

早在2025年5月的Qwen 3技能讲述中,Qwen团队就如故明确暗意,后来检修阶段的强化学习“聚焦于数学和编程任务”,并在瞻望部分坦承“规画加多强化学习算力,相等强调基于环境响应的agent强化学习系统”。

这个短板在benchmark上看得更显著。

在多个最能体现深度推理和复杂任务才智的测试中,Qwen 3.5-397B永远过期于同期发布的Gemini 3.1 Pro。

比如在GPQA Diamond(科学学问推理)上,Gemini 3.1 Pro得分是94.3%,Qwen 3.5唯有88.4%。在SWE-bench Verified(代码任务)上,Gemini 3.1 Pro达到 80.6%,Qwen 3.5则是76.4%。在MMLU系列测试中,Gemini 3.1 Pro的多话语版块得分92.6%,Qwen 3.5的MMLU-Pro是87.8%。

两者的差距,就贴近在需要多步规画、器具调用与自我纠错的复杂任务上。

周浩的野心恶果刚好能补上了这个缺口。它不需要稀少的东谈主工标注数据,不需要给模子灌注更多学问,就能让模子意志到极端在哪。

况兼周浩主导的多样貌强化学习,也弥补了Qwen在多步规画上的不及。

{jz:field.toptypename/}另外,Qwen 3.5如故具备了agent的基础才智。

2026年1月,千问App全面接入淘宝、支付宝、高德舆图、飞猪,罢显著“一句话点外卖、订机票、叫出租”。用户不错说“帮我订一张来日去北京的机票,预算2000以内,带行李额”,系统会自动比价、推选航班、跳转支付、完成出票。

但这些功能还相比低级,更像是把多个API串起来调用,而不是委果的多样貌推理。

如若航班取消了,AI能不成我方发现问题并切换有规画?如若用户说“帮我安排一个周末去杭州的行程”, AI能不成我方拆解成订票、订栈房、规画道路、推选餐厅这一系列子任务,然后一步步推论?这些皆需要更强的自我纠错和多样貌规画才智。

此前在林俊旸的主导下,Qwen 3.5还罢显著原生多模态。这是一种从预检修阶段运转,就把文本、图像、视频 token混在通盘进行检修的模式。

它能处理最高1344x1344分辨率的图片,以及60秒的视频片断。

这套架构和周浩在VideoPrism上作念的事情高度一致,他们皆是通过早期交融让模子同期学会语义意会和视觉细节。周浩对这套顺序论的深度意会,有望匡助千问在视频时序推理、动作意会等维度上罢了进一步冲破。

林俊旸期间,千问团队的中枢竞争力不仅仅技能,更是组织样式。预检修、后检修、多模态、基础设施全部在一个团队里面闭环,换取链路极短,一个技能判断不错今日落地实验。

但这种“一个东谈主的大脑”式的管束样式,在团队畛域扩大到几百东谈主之后,运转出现瓶颈。

阿里启动了官方架构调换,将原来闭环的团队拆分为预检修、后检修、文本、多模态等多个平行的水平单干模块,奏凯含糊了原来的垂直整合模式。

团队的窥察逻辑也因此发生调动,中枢KPI从原来的模子性能、榜单名次、开源影响力,转向了模子对集团业务的提效恶果、千问App的用户增长、买卖化ROI。

周浩要接的,即是这么一个摊子。

技能上如故走到天下前方,但有彰着短板;组织上从“野心优先”变成了“规画驱动”;策略上从开源模子转向C端超等进口,从技能品牌转向生计助手。

03

千问的改日是?

虽然,千问团队历久处于“算力饥渴”景况。吴泳铭也在里面会议上公开谈歉,说“莫得更早知谈资源的问题”。

但这仅仅里面矛盾的一面,委果决定此次东谈主事变动的,是它发生的时刻节点。

如今的千问正处于策略大调换,因此,底层模子的性能至关重要。

2025年11月,阿里将“通义”App 改名为“千问”,吴泳铭亲身拍板,并在财报分析师电话会上明确表态:“阿里巴巴必须要有一个AI原生的C端超等进口。”

3月2日,就在林俊旸发一又友圈告别的前一天,千问AI眼镜在 MWC 巴塞罗那寰球首秀,并于今日开启寰球预约。

阿里里面东谈主士显现,除AI眼镜以外,千问还会在年内不绝发布AI指环、AI耳机等产物,全部面向寰球市集发售。

“帮你劳动”和“陪你聊天”,是统统不同的两件事,对模子来说亦然如斯。

帮用户订一张机票,听起来简短,试验上需要模子完成一系列连贯动作:意会用户意图→调用高德/飞猪 API→处理复返戒指→识别异常(比如航班取消)→主动建议备选有规画→恭候用户阐明→完成支付。

任何一个要道出错,用户体验就会坍塌。

这不是一个聊天机器东谈主能作念到的,是以千问App 会从“对话框产物”变成“任务完成产物”。

当今掀开千问App,中枢交互如故一个聊天框。但有了周浩的多样貌强化学习加抓之后,不错预期千问会逐渐把“劳动”才智作念成孤苦的产物模块。

不是你问它“帮我订机票”,而是它主动在你说“来日要去北京开会”的时候,自动识别出这是一个需要订票、叫车、教导的复合任务,并一步步帮你完成,半途遭遇航班取消还能我方切换有规画。

这个产物形态,更接近一个“AI文书”。

阿里的上风就在于产业链竣工,不错无缝接入各式阿里系生计、购物产物,这亦然Gemini和ChatGPT现时皆还莫得作念到的。

同期我还觉得,千问眼镜会成为一种具多情境感知才智的AI助手。

现时市面上大大皆AI眼镜的中枢才智是“你问我答”,本色上是把手机语音助手搬到了脸上。

千问眼镜如若能把VideoPrism的视频时序意会才智委果落地,产物体验会有质的不同。

它不需要你启齿问,就能意会你正在作念什么、下一步可能需要什么。你走进超市,它知谈你在看货架。你在餐厅夷犹,它知谈你在对比菜单。

这种“主动感知、预判需求”的体验,才是AI眼镜相干于手机委果的各异化价值。

林俊旸把千问作念成了一个让寰球竖立者尊敬的技能品牌,那么周浩的任务,即是让千问委果信得过,不仅仅智谋,还要稳、准、能把事办完。

备案号:

备案号: